GitHubが汎用アクセシビリティエージェントを開発、その過程で得た知見 Building a general-purpose accessibility agent—and what we learned in the process

- GitHubはCopilot技術を活用し、Webやアプリのアクセシビリティ問題を自動で検出・修正する汎用エージェントを開発した。

- 開発過程で得たAIエージェント設計の知見や、アクセシビリティ自動化の限界と可能性を共有している。

English summary

- GitHub built a general-purpose accessibility agent leveraging Copilot technology to detect and fix accessibility issues, sharing lessons learned about AI agent design and the limits and potential of automated accessibility tooling.

GitHubは、Webサイトやアプリケーションのアクセシビリティ問題を自動的に発見し、修正案を提示する汎用エージェントを開発した。同社のCopilot技術を基盤としつつ、単なるコード補完を超えて、UIの構造や意味的なマークアップを理解し、スクリーンリーダー利用者を含む多様なユーザーに配慮した実装を支援することを目指している。

アクセシビリティの確保は、WCAG (Web Content Accessibility Guidelines) に代表される国際基準が存在するものの、実装現場では後回しにされがちな課題である。axe-coreやLighthouseといった既存の静的解析ツールは、コントラスト比や alt 属性の欠落など機械的に検出可能な問題は捉えられるが、フォーカス順序の妥当性やARIA属性の意味的な正しさといった文脈依存の判断は不得手だった。GitHubのエージェントは、LLMの文脈理解を活用してこうしたグレーゾーンに踏み込もうとするものと見られる。

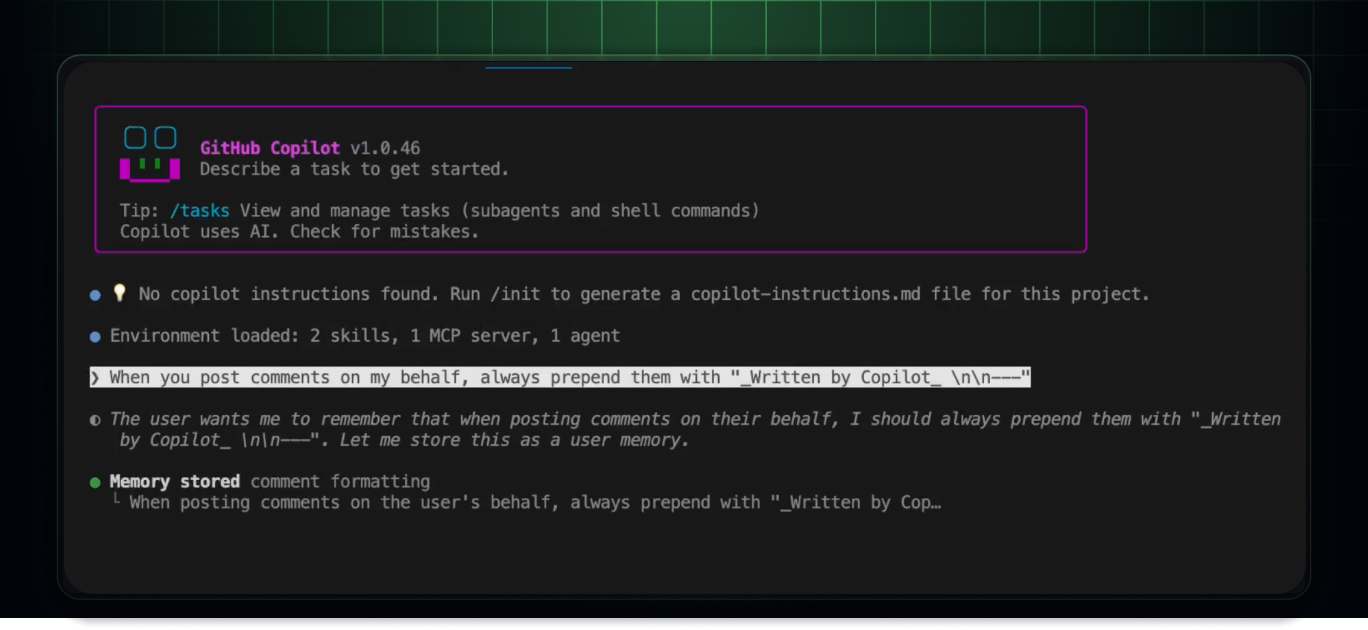

開発過程で得られた知見として、汎用エージェントの設計には、対象ドメインに特化したツール群 (検査ツール、ブラウザ自動操作、コード編集) をエージェントに適切に渡すことの重要性が挙げられている。またLLM単体では誤検出や過剰修正が起きやすく、決定論的な検証ステップとの組み合わせが品質の鍵となる。これはAnthropicやOpenAIなどが提唱する「ツール使用型エージェント」の設計思想とも軌を一にする。

GitHubはCopilot技術を活用し、Webやアプリのアクセシビリティ問題を自動で検出・修正する汎用エージェントを開発した。

関連動向として、MicrosoftのAccessibility Insights、DequeのAxe DevToolsなど、アクセシビリティ自動化分野は競争が激化している。AIエージェントによる修正の自動PR化は、人間のレビュー負荷を下げる一方で、誤った修正が混入するリスクもあり、ヒューマン・イン・ザ・ループの設計が引き続き重要となる可能性がある。

GitHub has built a general-purpose accessibility agent that automatically discovers and proposes fixes for accessibility issues in websites and applications. Built on top of Copilot's underlying technology, the agent aims to move beyond code completion toward understanding UI structure and semantic markup, supporting developers in delivering experiences that work for screen reader users and others who rely on assistive technology.

Accessibility remains a persistent challenge in software development. International standards such as WCAG provide clear targets, but in practice accessibility work is often deferred or handled superficially. Existing static analyzers like axe-core and Lighthouse can catch mechanically detectable issues such as missing alt text or insufficient color contrast, but they tend to struggle with context-dependent judgments like whether a focus order is logical or whether ARIA attributes are semantically appropriate. GitHub's agent appears to target precisely this gray zone, leveraging LLM-based contextual reasoning to evaluate intent rather than just syntax.

A recurring theme in the lessons shared is that building a useful general-purpose agent is less about the model itself and more about the surrounding scaffolding. The team emphasizes giving the agent access to the right domain-specific tools—accessibility scanners, browser automation for rendering and interaction, and code editing capabilities—and orchestrating them in a way the model can reason over. Pure LLM output is prone to hallucinated fixes or overcorrection, so combining probabilistic reasoning with deterministic verification steps emerged as critical to quality. This mirrors the broader industry consensus, echoed by Anthropic and OpenAI, that tool-using agents outperform monolithic prompts on practical tasks.

Another insight is the importance of iteration loops. Rather than trying to fix everything in one pass, the agent benefits from a cycle of detect, patch, re-test, and refine. This pattern is becoming standard for coding agents in general, with frameworks like SWE-agent and Cursor's background agents adopting similar architectures.

The accessibility tooling space is becoming increasingly crowded. Microsoft's Accessibility Insights, Deque's Axe DevTools, and various startup offerings are all pushing automation further, and the question of how much can be safely automated remains open. Automated PRs that fix accessibility issues can dramatically reduce reviewer burden, but a poorly judged fix—say, an ARIA label that misrepresents intent—can actively harm users who depend on assistive tech. Human-in-the-loop review is therefore likely to remain essential, at least for the foreseeable future.

For GitHub, the agent also serves as a testbed for general agent-building practice. Many of the patterns surfaced here—tool integration, verification loops, scoped autonomy—are likely to inform how Copilot's broader agentic capabilities evolve across other domains beyond accessibility.

本ページの本文・要約は AI による自動生成です。正確性は元記事 (github.blog) をご確認ください。